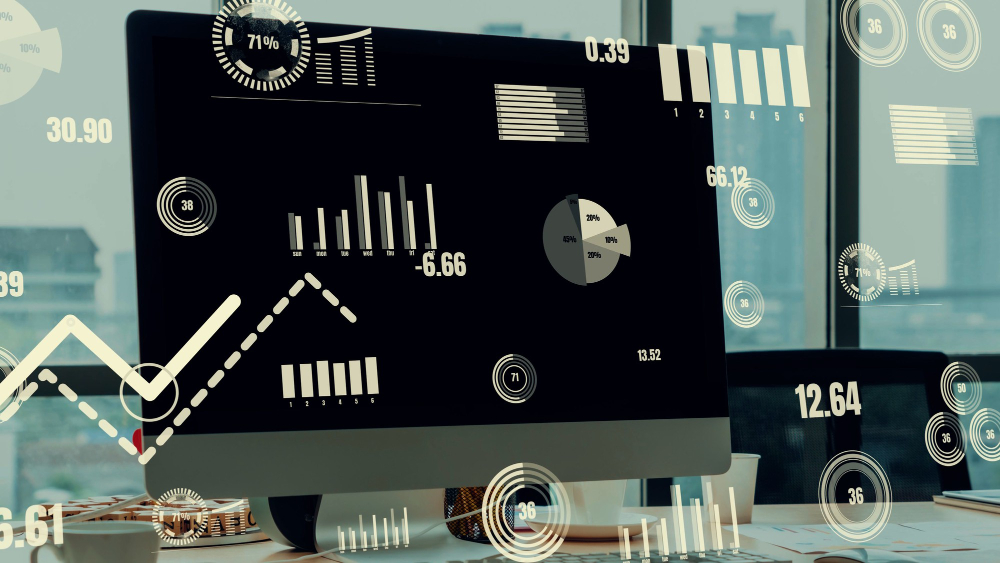

Die Big Data Analyse ist ein fortschrittlicher Prozess, der eingesetzt wird, um aussagekräftige Erkenntnisse aus riesigen und komplexen Datensätzen zu gewinnen, bei denen traditionelle Methoden nicht ausreichen.

Diese Datensätze umfassen vielfältige Daten aus Quellen wie Kommunikation, Sensorausgaben, Kundeninteraktionen und mehr. Unser Ziel ist es, aus schnell wachsenden und sich diversifizierenden Daten strategische Einblicke zu gewinnen, um Geschäftsprozesse zu optimieren.

BIG DATA – DAS 4V-MODELL

Volume (Datenvolumen)

Big Data umfasst Datensätze von Petabyte-Größe oder größer. Wir nutzen hochleistungsfähige Infrastrukturen, um diese riesigen Datenmengen zu sammeln und zu verarbeiten.

Velocity (Geschwindigkeit)

Big Data wird mit hoher Geschwindigkeit generiert und erfordert schnelle Analysen. Wir ermöglichen die Hochgeschwindigkeitsverarbeitung von Datenströmen aus Quellen wie Social-Media-Feeds und Echtzeit-Sensordaten.

Variety (Vielfalt)

Big Data besteht aus strukturierten, semi-strukturierten und unstrukturierten Datentypen. Um diese Vielfalt zu analysieren, setzen wir flexible und leistungsstarke Analysetools ein.

Veracity (Datenwahrheit)

Um die Genauigkeit der Informationen innerhalb von Big Data sicherzustellen, implementieren wir fortschrittliche Validierungs- und Bereinigungstechniken, die die Auswirkungen irreführender oder fehlerhafter Daten minimieren.

BIG DATA ANALYSEPROZESS

Unter Verwendung von Infrastrukturen wie Hadoop und Apache Kafka folgen wir nach der Datenerfassung dem unten aufgeführten Algorithmus:

Datenhaltung

Wir verwenden moderne Datenspeicherlösungen wie NoSQL-Datenbanken (z. B. MongoDB, Cassandra), um unstrukturierte und semi-strukturierte Daten zu speichern.

Datenverarbeitung

Mit verteilten Verarbeitungs-Engines wie Spark und Flink verarbeiten wir große Datensätze schnell und parallel, um sie für die Analyse vorzubereiten.

Datenanalyse

Mithilfe von maschinellem Lernen, Natural Language Processing (NLP) und prädiktiven Algorithmen gewinnen wir aussagekräftige Erkenntnisse aus großen Datensätzen. Dieser Schritt ermöglicht es uns, kritische Muster und Trends innerhalb der Daten zu identifizieren.