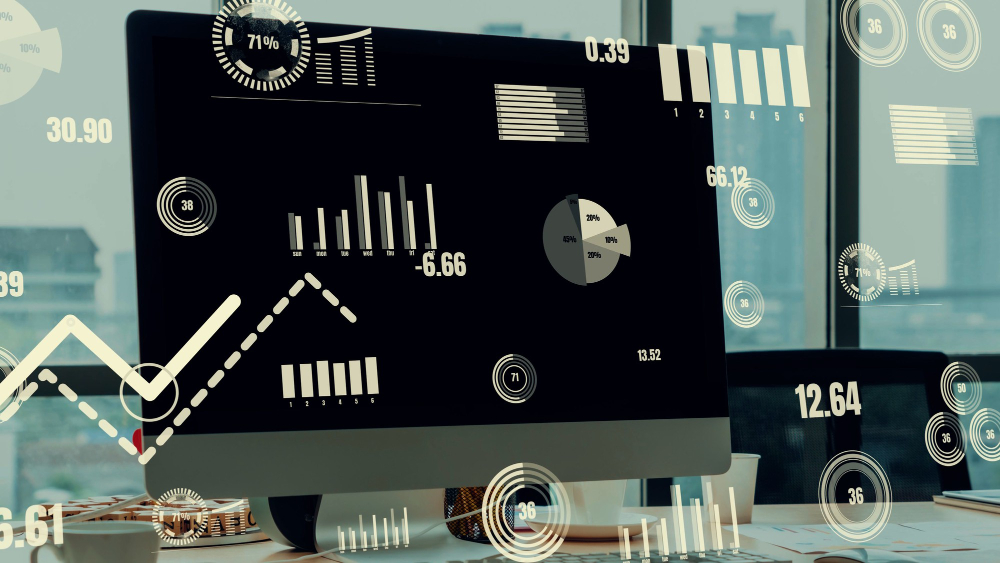

Büyük veri analizi, klasik yöntemlerin yetersiz kaldığı devasa ve karmaşık veri setlerinden anlamlı bilgiler elde etmek için kullandığımız ileri düzey bir süreçtir.

Bu veri setleri, iletişim, sensör verileri, müşteri etkileşimleri ve daha birçok kaynaktan gelen çeşitli verileri içermektedir. Bu bağlamda hızla büyüyen ve çeşitlenen bu verilerden stratejik sonuçlar çıkararak işletmelerin iş süreçlerini optimize etmeyi amaçlıyoruz.

Büyük Veri – 4V Modeli

Veri Hacmi (Volume)

Büyük veri, petabayt veya daha büyük hacimlerde veri setlerini içerir. Bu büyük miktarda veriyi toplamak ve işlemek için yüksek kapasiteli altyapılar kullanıyoruz.

Veri Hızı (Velocity)

Büyük veri, çok hızlı bir şekilde üretilir ve analiz edilmesi gerekir. Sosyal medya akışları ve gerçek zamanlı sensör verileri gibi kaynaklardan gelen verilerin yüksek hızda işlenmesini sağlıyoruz.

Veri Çeşitliliği (Variety)

Büyük veri, yapılandırılmış, yarı yapılandırılmış ve yapılandırılmamış veri türlerini içerir. Bu çeşitliliği analiz etmek için esnek ve güçlü analiz araçları kullanıyoruz.

Veri Doğruluğu (Veracity)

Büyük veri içindeki bilgilerin doğruluğunu sağlamak için gelişmiş doğrulama ve temizleme teknikleri uyguluyor, yanıltıcı ve hatalı verilerin etkisini en aza indiriyoruz.

Büyük veri analiz sürecinde Hadoop ve Apache Kafka gibi altyapıları kullanarak verilerin toplanmasının ardından ise aşağıda belirtilen algoritmayı takip ediyoruz.

Veri Depolama

Yapılandırılmamış ve yarı yapılandırılmış verilerin depolanması için NoSQL veritabanları (MongoDB, Cassandra) gibi modern veri depolama çözümlerini kullanıyoruz.

Veri İşleme

Spark ve Flink gibi dağıtık işlem motorları ile büyük veri setlerini hızlı ve paralel olarak işliyoruz. Bu adımda verilerin analiz için hazırlanmasını sağlıyoruz.

Veri Analizi

Makine öğrenmesi, doğal dil işleme ve tahminleme algoritmaları ile büyük veri setlerinden anlamlı bilgiler çıkarıyoruz. Bu süreçle verilerin içindeki önemli kalıpları ve eğilimleri tespit ediyoruz.